- 手机平板哪个牌子好(手机平板哪个牌子好用)

-

买手机和平板电脑在京东买比较好。因为买手机和平板电脑一般在京东享受的优惠会比拼多多得优惠多,而且京东的手机和平板电脑都是官方正品,不会是假货的,而且京东的物流网已经非常成熟的,只要当天下单,第二天就会...

- 电影明星女演员的名单(美国电影明星女演员的名单)

-

最性感的女演员中,很多网友觉得斯嘉丽·约翰逊应该排第一位,其实很个人心中的排名可能都不同,下面来介绍下网友在评论中推荐的心目中最性感的女演员,这次我们不排名次,大家自己在心中其实已经排好了。妮可·基德...

- 最热门的创业项目(最近火的创业项目)

-

网上看病,小区快件驿站,孩托中心。

-

- 猫的品种价格排行(猫品种价格排序)

-

阿舍拉猫、防敏感猫、孟加拉猫、彼得秃猫、俄罗斯蓝猫、斯芬克斯猫、苏格兰折耳猫、英国短毛猫、埃及猫、挪威森林猫。田园猫最多,其次是英短,包括蓝猫,银渐层,蓝白。再就是美短,起司,加菲猫,暹罗猫,布偶猫,其他也有金渐层,金吉拉,拿破仑,曼基康。...

-

2025-12-21 21:53 alicucu

-

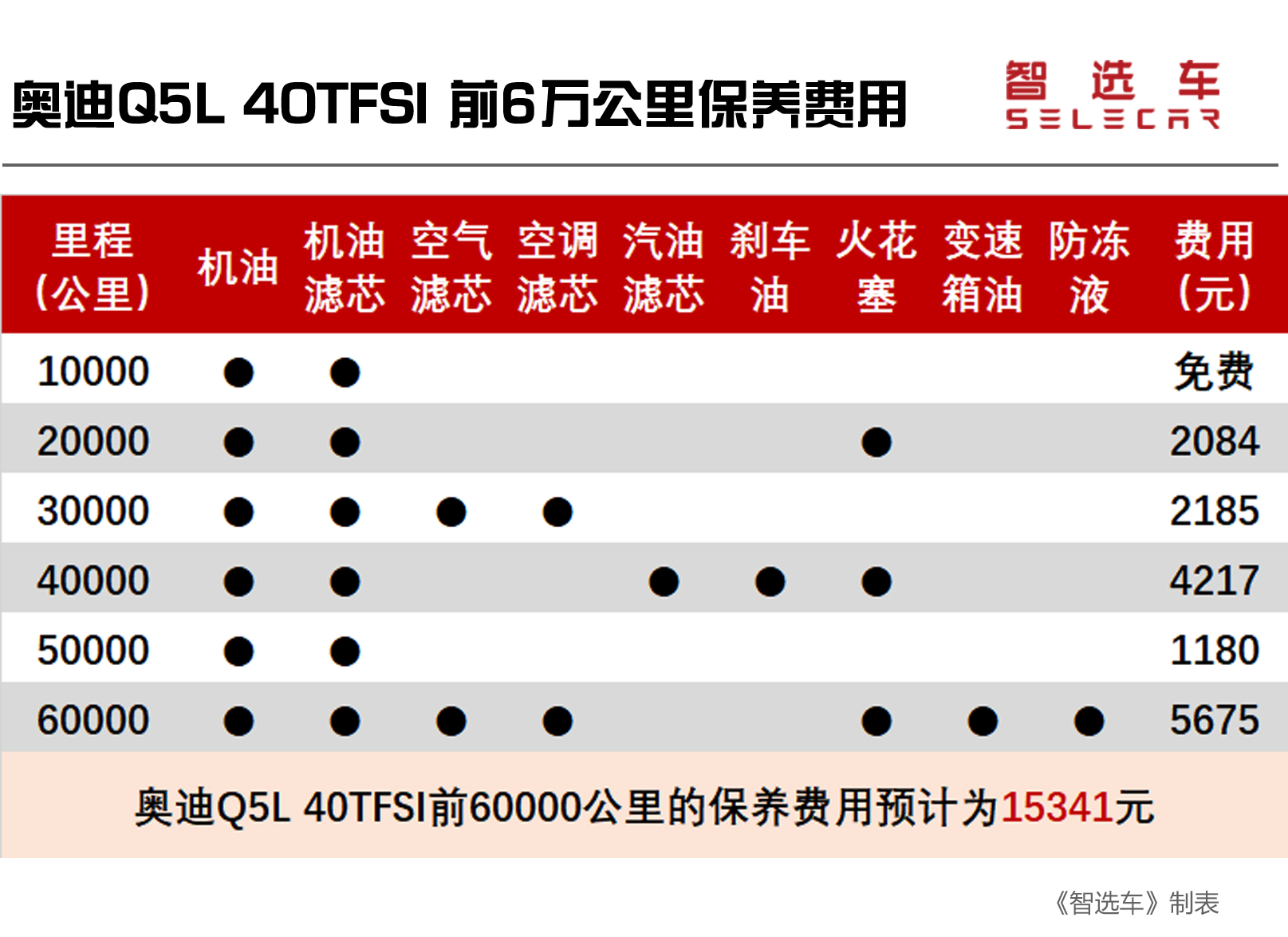

- 奥迪q5l报价(奥迪q5l报价及图片2026款价格及试驾视频)

-

奥迪Q5L2023款的大改款落地价大约在**39.75-48.88万元**之间。不过,具体的价格可能会因地区、经销商和购车时间等因素有所不同,购车前建议向官方或经销商咨询最新的价格信息与优惠政策。奥迪Q5L的顶配2022款45T甄选动...

-

2025-12-21 21:53 alicucu

- 最薄的手机是哪一款(最薄的手机排行榜2019)

-

目前,最薄的手机是Zancotinyt2,厚度仅为6.5毫米。它是一款迷你手机,具有基本的通话和短信功能,适合作为备用手机或旅行时的紧急联系工具。除此之外,还有一些其他品牌的手机也非常薄,如Viv...

- 十大著名恐龙(十大有名恐龙)

-

1.棘龙 棘龙是现代目前已知的最大的一种肉食类恐龙,化石于1915年在埃及被挖掘出,据科学家挖掘出的化石发现,它的最高体长能达到20.7米,而脚到地面的高度也有270到400厘米,预测最重的体格为2...

- seo推广是什么意思呢(seo推广必须要做的9种方法)

-

SEO属于自己的官方主业的推广渠道。SEO本身不是任何推广渠道,而是网页关键词优化的意思。用在市场推广的整体安排中,就是主要指对自家官方网站的关键词的优化工作。任何一个网站,发布的信息内容,都有对应的...

- 中国十大名楼(中国十大名楼都有哪些)

-

排在第十名的是长沙国金中心,它位于长沙市黄兴路与解放路的交汇处,这栋大楼高452米,始建于2011年,历时五年才建造而成,总共耗资500亿元。第九名是武汉绿地中心,它地处于武昌滨江商务区,高度达到了4...